AI時代產品競爭,離不開資源端(算力、數據等),尤其是穩定資源端做支持。

模型訓練/迭代同時還需要龐大的用戶標的(IP)來幫忙喂養資料,來對模型效率產生質變。

與Web3的結合,能夠幫助中小型AI初創團隊實現對傳統AI巨頭的彎道超車。

對于DePIN生態,算力、帶寬等資源端決定下限(單純算力集成沒有護城河);AI模型的應用、深度優化(類似BitTensor)、專業化(Render、Hivemaper)以及對數據的有效利用等維度決定項目上限。

AI+DePIN語境下,模型推理 & 微調,以及移動端AI模型市場將得到重視。

AI市場分析 & 三個問題

有數據統計,從2022年9月,ChatGPT誕生前夕到2023年8月,全球Top 50的AI產品就產生了超過240億次的訪問量,平均每月增長量為2.363億次。

AI產品的繁榮,背后是對于算力依賴程度的加劇。

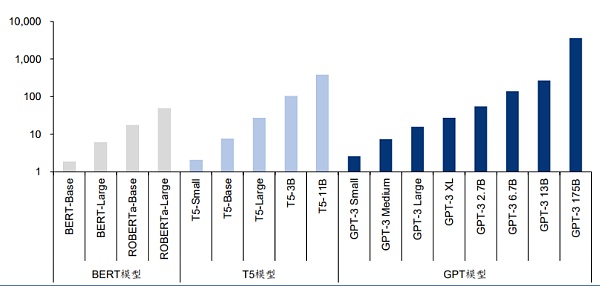

Source: "Language Models are Few-Shot Learners"

馬薩諸塞大學阿莫斯特分校的一篇論文指出,“訓練一個人工智能模型,其一生所排放的碳相當于五輛汽車的碳排放量。” 然而,這一分析僅涉及一次訓練。當模型通過反復訓練得到改進時,能量的使用將會大大增加。

最新的語言模型包含數十億甚至數萬億的權重。一種流行的模型GPT-3擁有1750億個機器學習參數。如果使用A100需要1024個GPU、34天和460萬美元來訓練該模型。

后AI時代的產品競爭,已經逐漸延展成為以算力為主的資源端戰爭。

Source:AI is harming our planet: addressing AI’s staggering energy cost

這就延展出三個問題:第一,一個AI產品是否有足夠的資源端(算力、帶寬等)尤其是穩定資源端做支持。這種可靠需要算力足夠的去中心化。在傳統領域,由于芯片需求端的缺口,再加上基于政策、意識形態構建的世界墻,讓芯片制造商天然處于優勢地位,并能夠大幅度哄抬價格。比如NVIDIA H100型號芯片從2023年4月份的3.6萬美元漲至5萬美元,這進一步加重了AI模型訓練團隊的成本。

第二個問題,資源端條件的滿足幫助AI項目解決了硬件剛需,但模型訓練/迭代同時還需要龐大的用戶標的(IP)來幫忙喂養資料。模型規模超過一定閾值之后,在不同任務上的性能都表現出突破式增長。

第三個問題在:中小型AI初創團隊難以實現彎道超車。傳統金融市場算力的壟斷性也導致AI模型方案也存在壟斷性,以OPenAI、Google Deepmind等為代表的大型AI模型廠商正在進一步構建自己的護城河。中小型AI團隊需要謀求更多的差異化競爭。

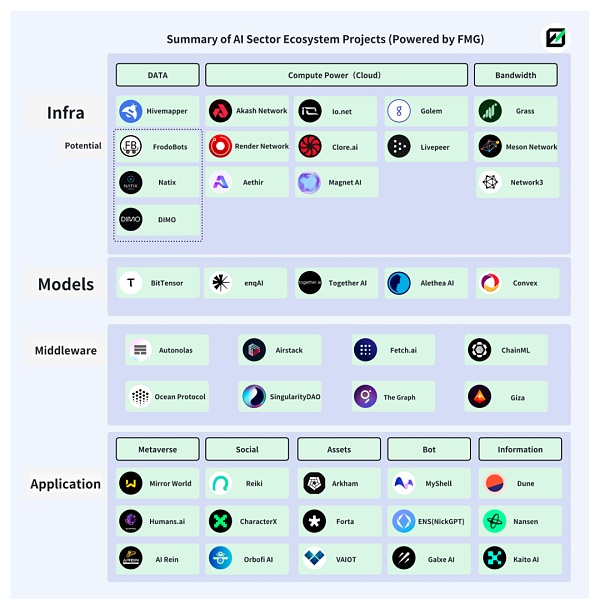

以上三個問題,都可以從Web3中找到答案。事實上,AI與Web3的結合由來已久,并且生態較為繁榮。

下圖為Future Money Group制作的AI+Web3生態的部分賽道&項目展示。

DePIN是去中心化物理基礎設施網絡的縮寫,同時也是人和設備的生產關系集合,通過代幣經濟學與硬件設備(比如計算機、車載攝像頭等)的結合,來將用戶與設備進行有機結合,同時實現經濟模型的有序運轉。

相較于定義更廣泛的Web3,由于DePIN天然與硬件設備和傳統企業有更深的關聯,因此DePIN在吸引場外AI團隊和相關資金方面有著天然的優勢。

DePIN生態對于分布式算力的追求和貢獻者的激勵,恰好解決了AI產品對于算力和IP的需求。

DePIN以代幣經濟學來推動世界算力(算力中心 & 閑置個人算力)的入駐,降低了算力的中心化風險,同時降低了AI團隊調用算力的成本。

DePIN生態數量龐大、多元化的IP構成幫助AI模型能夠實現數據獲取渠道的多樣性和客觀性,足夠多的數據提供者也能確保AI模型性能的提升。

DePIN生態用戶與Web3用戶在人物畫像上的重疊,能夠幫助入駐的AI項目開發出更多帶有Web3特色的AI模型,形成差異化競爭,這是傳統AI市場所不具備的。

在Web2領域,AI模型數據采集通常來自公開數據集或模型制作方自行收集,這就會受到文化背景和地域的限制,讓AI模型產出的內容存在主觀性“失真”。傳統數據采集方式又受限于采集效率和成本,難以獲得更大的模型規模(參數數量、訓練時長和數據質量)。對于AI模型而言,模型規模越大,模型的性能越容易引起質變。

Source:Large Language Models’ emergent abilities: how they solve problems they were not trained to address?

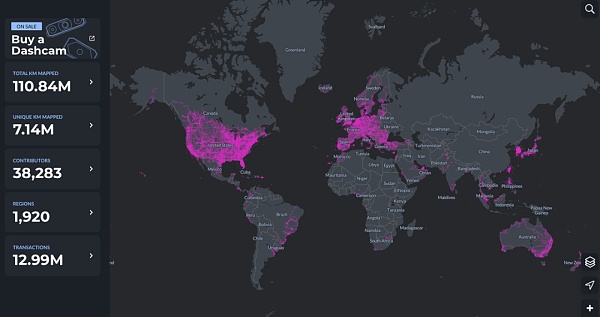

DePIN恰好在這一領域有著天然優勢。以Hivemapper為例,分布于全球1920個地區,接近4萬名貢獻者在為MAP AI(地圖AI模型)提供著數據。

AI與DePIN的結合還意味著AI與Web3的融合上升了新的高度。當前Web3中的AI項目,廣泛爆發于應用端,并且幾乎沒有擺脫對Web2基礎設施的直接依賴,即將依托于傳統算力平臺的已有AI模型植入到Web3項目中,對于AI模型的創建則很少涉獵。

Web3要素一直處于食物鏈下游,無法獲得真正的超額回報。對于分布式算力平臺而言也是如此,單純的AI+算力,并不能真正挖掘出二者的潛力,在這一關系中,算力提供方無法獲得更多超額利潤,且生態架構過于單一,因此也就無法通過代幣經濟學去促使飛輪運轉。

但AI+DePIN概念,正在打破這一固有關系,并將Web3的注意力轉移至更廣闊的AI模型方面。

DePIN內部天然擁有AI所亟需的設備(算力、帶寬、算法、數據)、用戶(模型訓練數據提供者),以及生態內激勵機制(代幣經濟學)。

我們可以大膽地下一個定義:為AI提供完備的客觀條件(算力/帶寬/數據/IP),提供AI模型(訓練/推理/微調)場景,并被賦予代幣經濟學的項目,可以被定義為AI+DePIN。

Future Money Group將會列舉以下AI+DePIN的經典范式進行梳理。

我們按照資源提供類別的不同,分成了算力、帶寬、數據、其他四個板塊,嘗試對不同板塊項目進行梳理。

算力端是AI+DePIN板塊的主要構成,也是目前項目構成數量最多的部分。算力端項目,算力的主要構成是GPU(圖形處理器)、CPU(中央處理器)和TPU(專業機器學習芯片)。其中,TPU由于制造難度高,主要由Google打造,只對外進行云算力租賃服務,因此市場規模較小。而GPU是一種與CPU類似,但更專業的硬件組件。與普通CPU相比,它可以更高效地處理并行運行的復雜數學運算。最初的GPU專用于處理游戲和動畫中的圖形渲染任務,不過現在它們的用途已遠超于此。因此,GPU是目前算力市場的主要來源。

因此,我們能夠看到的算力方面的AI+DePIN項目,很多都專長于圖形和視頻渲染,或者相關的游戲方面,這是由于GPU的特性導致的。

從全局看,算力類AI+DePIN產品,其算力的主要提供方由三部分構成:傳統云算力服務商;閑置個人算力;自有算力。其中,云算力服務商占比較大,閑置個人算力第二。這意味著此類產品更多時候扮演著算力中介的身份。需求端則是各種AI模型開發團隊。

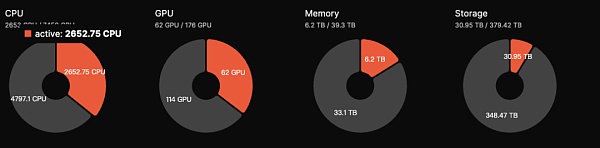

目前這一分類中,算力幾乎無法100%被運用于實際,更多時候處于閑置狀態。比如Akash Network,目前處于使用狀態的算力為35%左右,其余算力則處于閑置狀態。io.net也是類似情況。

這可能是目前AI模型訓練需求數量較少導致的,并且也是AI+DePIN能夠提供廉價算力成本的原因。后續隨著AI市場的擴大,這一情況將得以改善。

Akash網絡是一個去中心化的點對點云服務市場,通常被稱為云服務的Airbnb。Akash網絡允許不同規模的用戶和公司快速、穩定且經濟地使用他們的服務。

與Render類似,Akash同樣為用戶提供了GPU部署、租賃以及AI模型訓練等服務。

2023年8月,Akash上線了Supercloud,允許開發者設定他們愿意支付的價格來部署他們的AI模型,而具有額外計算能力的提供商則托管用戶的模型。該功能與Airbnb非常相似,允許提供商出租未使用的容量。

通過公開競價的方式,激勵資源提供方開放其網絡中的空閑計算資源,Akash Network實現了資源的更有效利用,從而為資源需求方提供了更具競爭力的價格。

目前Akash生態GPU總量為176枚GPU,但活躍數量為62枚,活躍度為35%,低于2023年9月份50%的水平。預估日收入為5000美元左右。AKT代幣具有質押功能,用戶通過將代幣進行質押以參與網絡安全的維護,獲得13.15%左右的年化收益。

Akash在當前AI+DePIN板塊數據表現比較優質,且7億美元的FDV相較于Render和BitTensor,具有較大上漲空間。

Akash還接入了BitTensor的Subnet,用于擴大自身發展空間。總體而言,Akash的項目作為AI+DePIN賽道的幾個優質項目之一,基本面表現優異。

io.net是一個去中心化計算網絡,支持在Solana區塊鏈上開發、執行和擴展ML (機器學習)應用程序,利用世界上最大的GPU集群,以允許機器學習工程師以相當于中心化服務成本的一小部分,來租用并訪問分布式云服務算力。

據官方數據顯示io.net擁有超過100萬個處于待命狀態的GPU。此外,io.net與Render的合作也擴展了可供部署的GPU資源。

io.net生態的GPU較多,但幾乎都是來自于與各云計算廠商的合作和個人節點的接入,且閑置率較高,以數量最多的RTX A6000為例,8426枚GPU中,只有11%(927)枚處于使用狀態,而更多型號的GPU幾乎沒有人使用。但目前io.net產品的一大優勢在于定價便宜,相較于Akash 1.5美元一小時GPU調用成本,io.net上成本最低能做到0.1-1美元之間。

后續io.net還考慮允許IO生態的GPU提供商通過抵押原生資產的方式來提高被使用的機會。投入資產越多,被選中的機會越大。同時,質押原生資產的AI工程師同樣可以使用高性能的GPU。

在GPU接入規模上,io.net是本文所列10個項目中最大的。刨除閑置率之外,處于使用狀態的GPU數量也處于第一。在代幣經濟學方面,io.net原生代幣與協議代幣IO將于2024年第一季度上線,最大供應量為22,300,000枚。用戶使用網絡時將收取5%的費用,該費用將用于Burn IO代幣或為供需雙方的新用戶提供激勵。代幣模型有著明顯的拉升特性,因此io.net盡管未發幣,但市場熱度很大。

Golem是一個去中心化算力市場,支持任何人都可以通過創建共享資源的網絡來共享和聚合計算資源。Golem為用戶提供了算力租賃的場景。

Golem市場由三方組成,分別是算力供應方、算力需求方、軟件開發者。算力需求方提交計算任務,Golem網絡將計算任務分配給合適的算力供應方(提供RAM、硬盤空間及CPU核數等),計算任務完成之后,雙方通過Token進行支付結算。

Golem主要采用CPU來進行算力堆疊,盡管在費用方面會比GPU的成本更低(Inter i9 14900k價格700美元左右,而A100 GPU價格在12000-25000美元)。但CPU無法進行高并發運算,且能耗更高。因此以CPU來進行算力租賃可能在敘事上相較于GPU項目會稍微弱一些。

Magnet AI通過整合GPU算力提供商,為不同AI模型開發者提供模型訓練服務。和其他AI+DePIN產品不同,Magent AI允許不同AI團隊基于自身模型發布ERC-20代幣,用戶通過參與不同模型互動,獲得不同模型代幣空投和額外獎勵。

2024年Q2,Magent AI將上線Polygon zkEVM & Arbrium。

與io.net有點類似,對于GPU算力都是以整合為主,并為AI團隊提供模型訓練服務。

不同點在于,io.net更側重于GPU資源的整合,鼓勵不同GPU集群、企業以及個人貢獻GPU,同時獲得回報,是算力驅動。

Magent AI看起來更側重AI模型,由于AI模型代幣的存在,可能會圍繞代幣、空投來完成用戶的吸引和留存,并通過這種將AI模型資產化的方式來推動AI開發者的入駐。

簡單概括:Magnet相當于用GPU搭建了一個集市,任何AI開發者,模型部署者都可以在上面發ERC-20代幣,用戶可以獲取不同代幣,或者主動持有不同代幣。

Render Network是基于去中心化GPU的渲染解決方案提供商,旨在通過區塊鏈技術連接創作者和閑置GPU資源,以消除硬件限制,降低時間和成本,同時提供數字版權管理,進一步推動元宇宙的發展。

根據Render白皮書內容,基于Render,藝術家、工程師和開發者可以創建一系列AI應用,比如AI輔助3D內容生成、AI加速全系渲染,以及利用Render的3D場景圖數據進行相關的AI模型的訓練。

Render為AI開發者提供了Render Network SDK,開發者將能夠利用Render的分布式GPU來執行從NeRF(神經反射場)和LightField渲染過程到生成性AI任務的AI計算任務。

根據Global Market Insights的報告,預計全球3D渲染市場規模達60億美元。而FDV 22億美元的Render相比仍具發展空間。

目前查詢不到Render基于GPU的具體數據,但由于Render背后OTOY公司數次表現出與蘋果公司的關聯性;再加上業務廣泛,OTOY旗下的明星渲染器OctaneRender,支持VFX、游戲、動效設計、建筑視覺化和模擬領域的所有行業領先的3D工具集,包括對于Unity3D和Unreal引擎的原生支持。

以及谷歌和微軟加入了RNDR網絡。Render曾在2021年處理了近25萬個渲染請求,生態中的藝術家通過NFT產生了50億美元左右的銷售額。

因此,對于Render的參考估值應該對照泛渲染市場潛力(約300億美元)。加上BME(燃燒和鑄造平衡)經濟模型,無論從單純代幣價格還是FDV來看,Render依舊有一定上漲空間。

Clore.ai是一個建立在PoW基礎上的提供GPU算力租用服務的平臺。用戶可出租自己的GPU用于AI培訓、視頻渲染和加密貨幣挖礦等任務,其他人可以以低價獲取這種能力。

業務范圍包括:人工智能培訓、電影渲染、VPN、加密貨幣挖礦等。有具體算力服務需求的時候,完成網絡分配的任務;如果沒有算力服務需求的時候,網絡找到當時挖礦收益率最高的加密貨幣,參與挖礦。

Clore.ai過去半年,GPU數量從2000漲到9000左右,但從GPU集成數量上來看,Clore.ai超過Akash。但其二級市場FDV只有Akash的20%左右。

代幣模型上,CLORE采用POW挖礦模式,沒有預挖和ICO,每個區塊的50%分配給礦工,40%分配給出租者,10%分配給團隊。

代幣總量13億枚,自2022年6月開始挖礦,至2042年基本進入全流通,當前流通量大約為2.2億枚。2023年底流通量約為2.5億枚,占代幣總量的20%。所以當前實際FDV為3100萬美元,理論上,Clore.ai處于嚴重被低估狀態,但由于其代幣經濟學上,礦工分配比例50%,挖賣提比例過高,因此幣價提升具有較大阻力。

Livepeer是基于以太坊的去中心化視頻協議,向以合理價格安全地處理視頻內容的各方發放獎勵。

據官方稱,Livepeer每周有數千個GPU資源進行數百萬分鐘的視頻轉碼。

Livepeer或將采用“主網”+“子網”的方式,讓不同的節點運營商生成子網,通過在 Livepeer 主網上兌現付款來執行這些任務。比如,引入AI視頻子網用于專門進行視頻渲染領域的AI模型訓練。

Livepeer此后會將與AI有關的部分從單純的模型訓練擴列至推理 & 微調。

Aethir是一個云游戲平臺,專為游戲和人工智能公司構建的去中心化云基礎設施 (DCI)。它有助于代替玩家交付繁重的GPU計算負載,確保游戲玩家在任何地方、任何設備上都能獲得超低延遲的體驗。

同時,Aethir提供包括GPU、CPU、磁盤等要素的部署服務。2023年9月27日,Aethir正式為全球客戶提供云游戲和AI算力的商用服務,通過集成去中心化算力的方式來為自身平臺的游戲以及AI模型提供算力支持。

云游戲通過將計算渲染的算力需求轉移到云端,消除了終端設備的硬件及操作系統的限制,顯著擴大了潛在的玩家基礎規模。

帶寬是DePIN向AI提供的資源中的一種,2021年全球帶寬市場規模超過500億美元,預測2027年將突破千億。

由于AI模型的越來越多以及更復雜,模型訓練通常采用多種并行計算策略,例如數據并行、流水線并行和張量并行等。在這些并行計算模式下,多臺計算設備間集體通信操作的重要性日益凸顯。因此,在構建大型AI模型的大規模訓練集群時,網絡帶寬的作用就凸顯了出來。

更重要的是,一個穩定且足夠可靠的帶寬資源,能夠確保不同節點之間同時相應,技術上避免了單點控制的出現(比如Falcon采用低延遲+高帶寬的中繼網絡模式來尋求延遲與帶寬之間需求的平衡),最終確保整個網絡的可信任和抗審查。

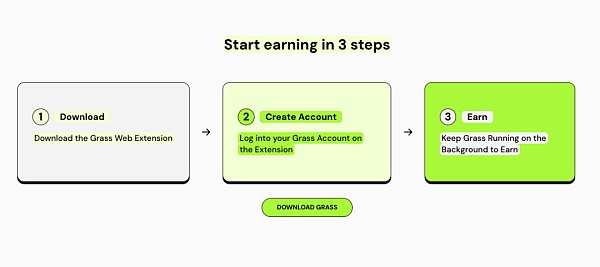

Grass是Wynd Network的旗艦產品, Wynd專注于開放?絡數據,于2023年融資100萬美元。Grass允許?戶通過出售未使?的?絡資源來通過互聯?連接來獲得被動收?。

用戶可以在Grass上出售互聯網帶寬,為有需要的AI開發團隊提供帶寬服務,幫助AI模型訓練,從而獲得代幣回報。

目前,Grass即將推出移動端版本,由于移動端與PC端具有不同的IP地址,這意味著Grass的用戶將為平臺同時提供更多的IP地址,而Grass將收集到更多的IP地址從而為AI模型訓練提供更好的數據效率。

目前Grass有兩種IP地址提供方式:PC端下載拓展程序,以及移動端APP下載。(PC端與移動端需處于不同網絡)

截至2023年11月29日,Grass平臺已經擁有103,000次下載和1,450,000個唯一IP地址。

移動端和PC端對AI的需求度不一樣,因此適用的AI模型訓練類別有所不同。

比如,移動端對于圖片優化、人臉識別、實時翻譯、語音助手、設備性能優化等方面擁有大量數據。這些是PC端難以提供的。

目前Grass在移動端AI模型訓練上處于比較先發的身位。考慮到當前全球范圍內,移動端市場的巨大潛力,Grass的前景值得關注。

但目前Grass尚未在AI模型方面提供更有效的信息,推測前期可能單純以礦幣為主要運營方式。

Meson Network是基于區塊鏈Layer 2的下一代存儲加速網絡,通過挖礦的形式聚合閑置服務器,調度帶寬資源并將其服務于文件以及流媒體加速市場,包含傳統網站、視頻、直播及區塊鏈存儲方案。

我們可以將Meson Network理解為一個帶寬資源池,池子兩邊可以看作是供需雙方。前者貢獻帶寬,后者使用帶寬。

在Meson具體的產品結構中,有2個產品(GatewayX、GaGaNode)在負責接收全球不同節點貢獻的帶寬,1個產品(IPCola)則負責將這些匯聚的帶寬資源進行變現。

GatewayX:以集成商業閑置帶寬為主,主要瞄準IDC中心。

從Meson的數據看板可以發現,目前接入的IDC在全世界范圍內共有2萬多個節點,并且形成了12.5Tib/s的數據傳輸能力。

GaGaNode:主要整合住宅及個人設備閑置帶寬,提供邊緣計算輔助。

IPCola:Meson變現渠道,進行IP和帶寬分配等任務。

目前Meson透露,半年收入在百萬美金以上。據官網統計,Meson有IDC節點27116個,IDC容量17.7TB/s。

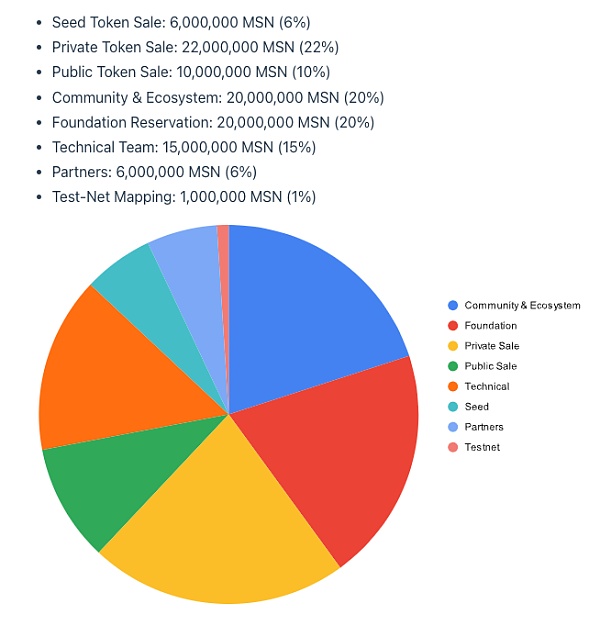

目前Meson預計2024年3-4月份發行代幣,但公布了代幣經濟學。

代幣名稱:MSN,初始供應量1億枚,第一年挖礦通脹率為5%,每年下降0.5%。

Network3是一家AI公司,構建了一個專門的AI Layer 2,并與Sei集成。通過AI模型算法優化和壓縮,邊緣計算和隱私計算,為全球范圍內的AI開發者提供服務,幫助開發者快速、便捷、高效地大規模訓練和驗證模型。

據官網數據,目前Network3已經有超過58000個活躍節點,提供2PB的帶寬服務。與Alchemy Pay、ETHSign、IoTeX等10個區塊鏈生態達成合作。

與算力和帶寬不同,數據端供應目前市場較為小眾。并且具有鮮明的專業性。需求群體通常是項目自身或者相關品類的AI模型開發團隊。比如Hivemapper。

通過自身數據喂養訓練自己的地圖模型,這一范式在邏輯上并不存在難點,因此我們可以嘗試將視野放寬到與Hivemapper類似的DePIN項目中,比如DIMO、Natix和FrodoBots。

HiveMapper是Solana上DePIN概念Top之一,致力于創建一個去中心化的”谷歌地圖“。用戶通過購買HiveMapper推出的行車記錄儀,通過使用并與HiveMapper共享實時影像,便能獲得HONEY代幣。

關于Hivemapper,Future Money Group曾在《FMG 研報:30天上漲19倍,讀懂以Hivemapper為代表的汽車類DePIN業態》中有詳細描述,在此不做展開。之所以把Hivemapper列入AI+DePIN板塊,是因為Hivemapper推出了MAP AI,是一個AI地圖制作引擎,可以基于行車記錄儀所采集的數據生成高質量地圖數據。

Map AI設置了一個新角色,AI訓練師。該角色該角色囊括了此前的行車記錄儀數據貢獻者,以及Map AI模型訓練師。

Hivemapper對于AI模型訓練師的要求并沒有刻意專業化,反而采用了類似遠程任務、猜地理位置等類似游戲行為的低參與門檻,讓更多的IP地址參與進來。DePIN項目的IP資源越豐富,AI獲取數據的效率就更高。而參與AI訓練的用戶,同樣也能獲得HONEY代幣的獎勵。

AI在Hivemapper中的應用場景較為小眾,Hivemapper也并不支持第三方模型訓練,Map AI目的在于優化自身地圖產品。因此對Hivemapper的投資邏輯不會產生改變。

DIMO是一個建立在Polygon上的汽車物聯網平臺,使駕駛員能夠收集和共享他們的車輛數據,記錄的數據包括汽車行駛公里、行駛速度、位置追蹤、輪胎壓力、電池/發動機健康狀況等。

通過分析車輛數據,DIMO平臺可以預測何時需要維護并及時提醒用戶。駕駛員不僅能深入了解自己的車輛,還能將數據貢獻給DIMO的生態系統,從而可以獲得DIMO代幣作為獎勵。而作為數據消費方可以從協議中提取數據以了解電池、自動駕駛系統和控件等組件的性能。

Natix是一個利用AI隱私專利打造的去中心化網絡。旨在基于AI隱私專利,將全球與攝像頭設備(智能手機、無人機、汽車)進行結合,創建中保攝像頭網絡,同時在隱私合規性的前提下收集數據,并對去中心化動態地圖(DDMap)進行內容填充。

參與數據提供的用戶可以獲得代幣和NFT進行激勵。

FrodoBots是一個以移動機器人為載體,通過攝像頭采集影響數據,具有一定社交屬性的DePIN類游戲。

用戶通過購買機器人來參與到游戲過程中,與全球玩家進行交互。同時機器人自帶的攝像頭也會對道路和地圖數據進行采集匯總。

以上三個項目,都具有數據采集和IP提供兩個要素,盡管他們尚未進行相關的AI模型訓練,但都為AI模型的引入提供了必要條件。這些項目包括Hivemapper在內,都是需要通過攝像頭來采集數據,并形成完備的圖譜。因此適配的AI模型也都局限于以地圖構建為主的領域。AI模型的賦能,將能夠幫助幫助項目建立更高的護城河。

需要注意的點在于,通過攝像頭采集往往會遇到雙向的隱私侵犯等法規問題:比如外置攝像頭采集外部影像對于路人肖像權的定義;以及用戶對自身隱私的重視。比如Natix運營AI來進行隱私保護。

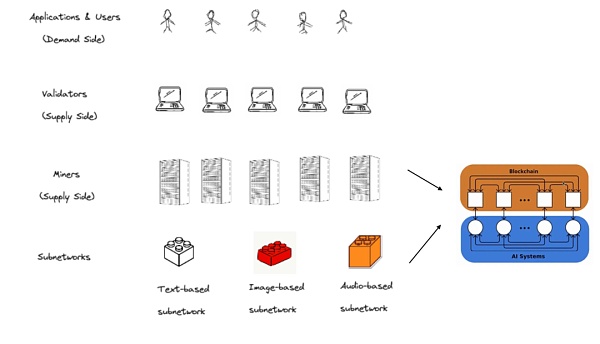

算力、帶寬、數據側重于資源端的區分,而算法則側重于AI模型方面。本文以BitTensor為例,BitTensor既直接不貢獻數據,也不直接貢獻算力,而是通過區塊鏈網絡和激勵機制,來對不同的算法進行調度和篩選,從而讓AI領域形成一個自由競爭、知識共享的模型市場。

類似OpenAI,BitTensor目的在于在維持模型去中心化特性的同時,以達到與傳統模型巨頭相匹配的推理性能。

算法賽道具有一定超前性,類似的項目并不多見。當AI模型,尤其是基于Web3誕生的AI模型涌現,模型之間的競爭就將成為常態化。

同時,模型之間的競爭也會讓AI模型產業的下游:推理、微調的重要性提高。AI模型訓練只是AI產業的上游,一個模型需要先經過訓練,具備初始的智能性,并在此基礎上對模型進行更仔細的模型推理和調整(可以理解為優化),最終才能作為一個成品來進行邊緣部署。這這些過程需要更復雜的生態架構和算力支撐。也意味著潛在的發展潛力巨大。

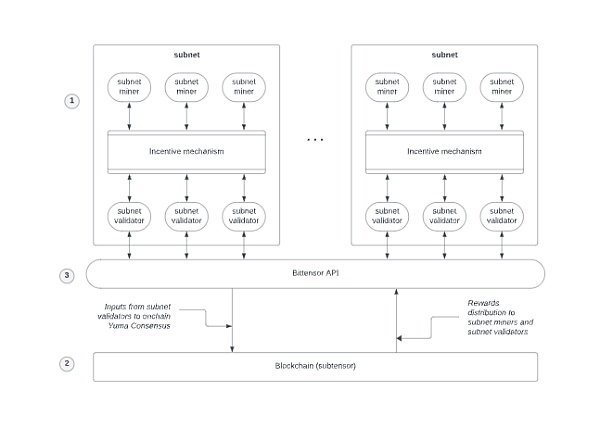

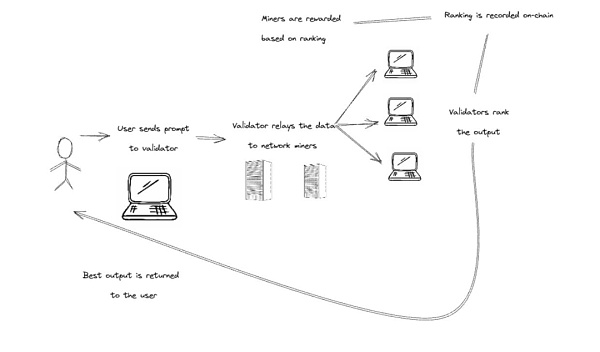

BitTensor是一個架構類似Polkadot主網+子網的去中心化機器學習生態。

工作邏輯:子網將活動信息傳給Bittensor API(角色類似預言機),然后API會將有用信息傳給主網,主網再分發Rewards。

BitTensor 32個子網

BitTensor生態內角色:

礦工:可以理解為全世界各種AI算法和模型的提供方,它們托管AI模型并將其提供給Bittensor網絡;不同類型的模型組成了不同的子網。

驗證者:Bittensor網絡內的評估者。評估AI模型的質量和有效性,根據特定任務的性能對AI模型進行排名,幫助消費者找到最佳解決方案。

用戶:Bittensor提供的AI模型最終使用方。可以是個人,也可以是謀求AI模型來做應用的開發者們。

提名人:將代幣委托給特定驗證者來表示支持,也可以換不同的驗證者來委托。

開放的AI供需鏈條 :有人提供不同模型,有人評價不同模型,有人使用最好的模型所提供的結果。

和Akash、Render這種類似“算力中介”的角色不同,BitTensor更像一個“勞務市場”,用已有模型去吸收更多數據以此來讓模型更加合理。礦工和驗證者更像“施工方”和“監工”的角色。用戶提出問題,礦工們輸出答案,驗證者再來評估答案的質量,最終返回給用戶。

BitTensor代幣為TAO。TAO的市值目前僅次于RNDR,但由于4年減半的長期釋放機制存在,市值與完全稀釋價值的比率反而是幾個項目中最低的,也意味著TAO的總體流通量目前來看相對較低,但單價較高。因此意味著TAO的實際價值處于低估狀態。

目前比較難以尋找合適估值標的,如果從架構相似性出發,Polkadot(約120億美元)為參照對象,TAO有接近8倍的上漲空間。

如果按照“預言機”屬性出發,Chainlink(140億美元)為參照對象,TAO有接近9倍的漲幅。

如果以業務相似性出發,OpenAI(從微軟獲得約300億美元)為參照,TAO的上漲硬頂可能在20倍左右。

結論

總體而言,AI+DePIN推動了Web3語境下AI賽道的范式轉移,讓市場從“AI能在Web3里做什么?”的固有思維中跳出,去思考“AI和Web3能為世界帶來什么?”這一更大的問題。

如果說英偉達CEO黃仁勛將生成式大模型的發布稱為AI的 “iPhone” 時刻,那么AI與DePIN的結合便意味著Web3真正迎來“iphone”時刻。

DePIN作為Web3在現實世界最容易被接受以及最成熟的用例,正在讓Web3變的更加可被接受。

由于AI+DePIN項目中IP節點與Web3玩家的部分重合性,二者的結合,同時也在幫助行業催生屬于Web3自己的模型和AI產品。這將有利于Web3行業的整體發展,并且為行業去開拓新的賽道,比如AI模型的推理和微調、以及移動端AI模型發展等。

一個有趣的點在于,文中所羅列的AI+DePIN的產品,似乎可以去嵌套公鏈的發展路徑。在此前的周期中,各種新公鏈涌現,用自身的TPS和治理方式來吸引各種開發者的入駐。

當前的AI+DePIN產品也是這樣,基于自身的算力、帶寬、數據以及IP優勢來吸引各種AI模型開發者入駐。所以,我們目前看到AI+DePIN產品有偏向同質化競爭的趨勢。

問題的關鍵并不在于算力的多少(盡管這是個很重要的先決條件),而在于如何去運用這些算力。現在的AI+DePIN賽道仍舊處于“野蠻生長”的早期,因此我們對于AI+DePIN的未來格局以及產品形式,可以抱有一個充滿期待的預期。

參考文獻

1.https://www.techopedia.com/decentralized-physical-infrastructure-networks-DePIN-brings-ai-and-crypto-together

2.https://medium.com/meson-network/with-the-increasing-ai-and-DePIN-trends-why-should-you-consider-keeping-an-eye-on-meson-network-59094665c9bd

3.https://medium.com/cudos/the-rise-of-DePIN-unveiling-the-future-of-ai-and-metaverse-compute-requirements-213f7b5b1171

4.https://www.numenta.com/blog/2022/05/24/ai-is-harming-our-planet/

5.https://www.techflowpost.com/article/detail_15398.html

6.https://www.numenta.com/blog/2022/05/24/ai-is-harming-our-planet/

7.https://mirror.xyz/livepeer.eth/7yjb5osZ28AJ9xvA54bZ4T2hUpNM5O9rrpv-zmGWDZ4

<strike id="ykeqq"></strike>

<fieldset id="ykeqq"></fieldset>